Estrategias educativas para la supervisión clínica del uso de la inteligencia artificial por los profesionales en formación

La inteligencia artificial tiene la capacidad de transformar fundamentalmente el aprendizaje y la práctica médica. Al igual que en otras profesiones, el uso de la IA en la formación médica podría resultar en profesionales altamente eficientes, pero menos capaces de resolver problemas de forma independiente y realizar evaluaciones críticas que sus homólogos pre-IA. El artículo revisa estrategias para supervisar el uso de la IA por profesionales en formación. New England Journal of Medicine, agosto de 2025.

Las interacciones entre humanos y computadoras se han dado durante décadas, pero los recientes avances tecnológicos en inteligencia artificial (IA) médica han dado lugar a interacciones más efectivas y potencialmente más peligrosas. Si bien el entusiasmo en torno a la IA se relaciona con revoluciones tecnológicas anteriores, como el desarrollo de internet y la historia clínica electrónica, la aparición de los grandes modelos de lenguaje (LLM) parece diferente.

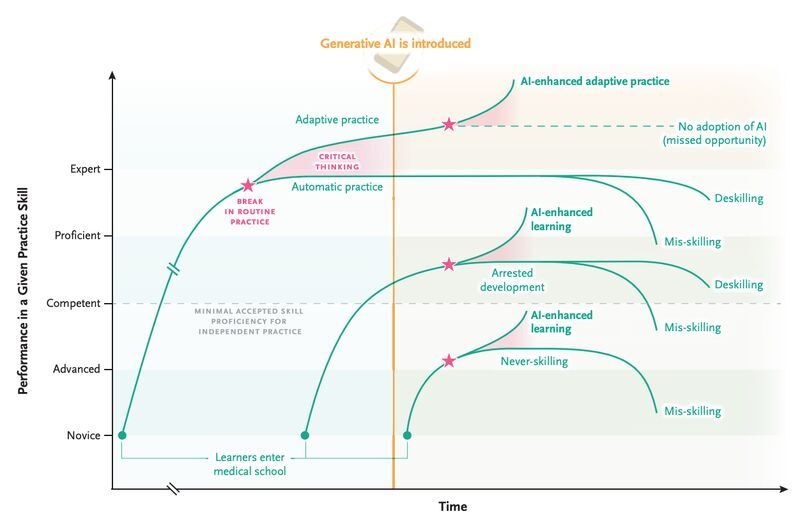

Los LLM pueden simular la generación de conocimiento y el razonamiento clínico con una fluidez similar a la humana, lo que les da la apariencia de agencia y procesamiento independiente de la información. Por lo tanto, la IA tiene la capacidad de transformar fundamentalmente el aprendizaje y la práctica médica. Al igual que en otras profesiones, el uso de la IA en la formación médica podría resultar en profesionales altamente eficientes, pero menos capaces de resolver problemas de forma independiente y realizar evaluaciones críticas que sus homólogos pre-IA.

Este desafío presenta oportunidades y riesgos educativos. La IA puede mejorar el aprendizaje basado en simulación, la recuperación de conocimientos y la retroalimentación "justo a tiempo", y puede utilizarse para la descarga cognitiva de tareas memorísticas. Con la descarga cognitiva, los estudiantes recurren a la IA para reducir la carga en su memoria de trabajo, una estrategia que facilita la interacción mental con tareas más exigentes. Sin embargo, la descarga de tareas complejas, como el razonamiento clínico y la toma de decisiones, puede conducir potencialmente a sesgos de automatización (dependencia excesiva de sistemas automatizados y riesgo de error), pérdida de habilidades (pérdida de habilidades previamente adquiridas), falta de desarrollo de habilidades (incapacidad para desarrollar competencias esenciales) y falta de habilidades (refuerzo de comportamientos incorrectos debido a errores o sesgos de la IA). Estos riesgos son especialmente preocupantes porque los LLM funcionan como cajas negras impredecibles; generan respuestas probabilísticas con baja transparencia de razonamiento, lo que limita la evaluación de su fiabilidad. Por ejemplo, en un estudio, más de un tercio de los estudiantes de medicina avanzados no respondieron correctamente a situaciones clínicas.

[...]

Una vez que el educador reconoce una interacción con IA, surge la oportunidad de crear un momento educativo y cultivar el pensamiento crítico. Basándose en modelos existentes que aprovechan los efectos de un enfoque socrático para mejorar el pensamiento crítico, el marco DEFT (diagnóstico, evidencia, retroalimentación y enseñanza) enfatiza las discusiones estructuradas sobre razonamiento clínico, el apoyo probatorio y la retroalimentación específica. Proponemos un enfoque adaptado, "DEFT-IA", diseñado para promover el pensamiento crítico y el desarrollo de prácticas adaptativas cuando un alumno, con la ayuda de IA, participa en el razonamiento clínico. Si bien DEFT se desarrolló fuera del contexto de las interacciones con IA, tiene sólidas raíces en la teoría educativa, y su enfoque sensato resonará con los educadores de primera línea que negocian cualquier interacción entre el alumno y la IA. A continuación, analizamos cómo cada uno de los componentes de DEFT conduce a una recomendación para la interacción con IA.

[...]

El artículo original:

Abdulnour REE, Gin B, Boscardin CK. Educational Strategies for Clinical Supervision of Artificial Intelligence Use. N Engl J Med 2025;393:786-797. DOI: 10.1056/NEJMra2503232

Disponible en: https://n9.cl/jgp86t